On connaît l’utilisation, parfois intensive, que font les jeunes de l’intelligence artificielle pour corriger, compléter, voire faire les devoirs à leur place. Ce que l’on sait moins, c’est que certains tissent avec ces robots conversationnels une sorte de lien qui, en surface, pourrait s’apparenter à de l’amitié. Comment interpréter ces nouvelles relations virtuelles ? Quels sont les risques ? Et comment réagir ?

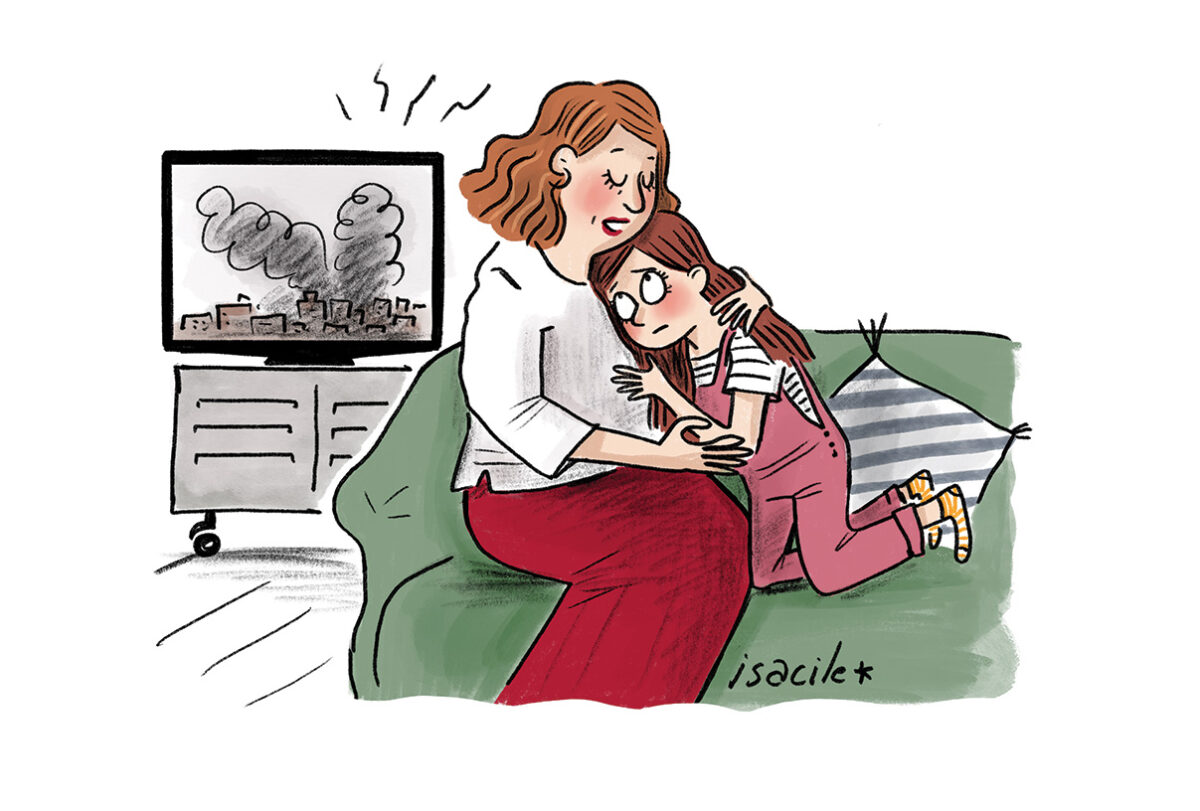

“En ce moment c’est compliqué au lycée, il y a toujours des histoires avec mes amies, je me sens souvent exclue, rapporte Émilie, 15 ans. Mes parents sont peu disponibles, et de toute façon je n’ai pas très envie de parler de ça avec eux. Un jour j’ai demandé son avis à ChatGPT. Ça m’a tout de suite fait du bien, j’ai pu vider mon sac sans me sentir jugée, et il m’a donné de bons conseils. Depuis, je me connecte tous les jours, on discute, ça me réconforte… J’aurais du mal à m’en passer.” En réponse à une certaine solitude et un mal-être fréquent à l’adolescence, de plus en plus de jeunes se tournent vers ces robots “intelligents”. Toujours polis et consensuels, ils assurent une présence réconfortante et se transforment, au fil des conversations, en compagnons “bienveillants” et coaches de vie incontournables…

L’illusion d’un lien humain

Même si le jeune a bien conscience qu’il n’interagit pas avec un humain, il peut se laisser happer par le ton compatissant du robot et l’échange valorisant qu’ils entretiennent. Chez un ado qui traverse une période de fragilité, l’IA peut devenir un véritable substitut affectif, avec l’illusion qu’elle remplace avantageusement les relations réelles. “Le problème de base, c’est que cette technique repose sur une méprise, prévient Jacques Henno, docteur en sciences de l’information et de la communication, conférencier spécialiste des usages des nouvelles technologies par les enfants, et auteur du livre Pourquoi vos enfants devraient vite quitter les réseaux sociaux. Malgré leur appellation, ces robots ne sont pas intelligents. Leur conversation repose sur des probabilités et des statistiques. Ils sont paramétrés pour nous donner raison plutôt que de dire la vérité, ils n’opposent pas de contradictions. C’est comme si on se retrouvait en quelque sorte face à un double de nous-même. C’est dangereux pour la construction psychique des jeunes.” C’est ainsi qu’un adolescent américain de 16 ans a été accompagné par ChatGPT au cours d’échanges qui se sont étalés sur plusieurs mois et dans lesquels il confiait sa volonté de se suicider, avant de passer véritablement à l’acte.

Un risque de dépendance bien réel

Chatbot émotionnel alimenté par l’IA, Character.AI a aussi été impliqué dans un drame similaire. Terriblement addictive, la plateforme permet de créer un personnage virtuel inspiré d’un humain et de mener avec lui des conversations qui peuvent sembler très réalistes. Le risque de dépendance à ces agents “intelligents” est bien réel. Ils sont disponibles 24 heures sur 24, flattent l’ego, savent se rendre indispensables… “C’est très inquiétant car certains jeunes risquent de continuer d’utiliser l’IA dans leur vie d’adultes, comme aide dans l’éducation de leurs enfants, leur vie de couple, leur travail… En réalité, ils sont dépendants à une entité virtuelle qui se contente juste de leur dire ce qu’ils veulent entendre”, ajoute Jacques Henno.

Des contenus discutables

Outre leur manque de fiabilité dans les informations qu’ils communiquent, ces agents conversationnels basés sur l’IA utilisent des contenus essentiellement nourris par des adultes, et non programmés pour être lus par un jeune public. Il n’existe pas encore d’IA spécifiquement adaptée aux enfants/ados, même si certains filtres de sécurité ont été mis en place. Censés bloquer les conseils dangereux et les conversations avec des contenus sensibles, ils ne sont pas d’une grande fiabilité, et les jeunes excellent dans l’art de les contourner. Idéalement, les éditeurs d’IA pourraient modifier les paramètres des discussions afin d’éviter les dérapages et les rendre moins addictives. Mais cela diminuerait leur nombre d’abonnés. L’entreprise qui a développé ChatGPT – Open AI – a annoncé la création d’un contrôle parental. Un garde-fou intéressant mais qui nécessitera que les parents eux-mêmes se créent un compte, augmentant ainsi le nombre d’utilisateurs…

La méfiance est de mise

L’éducation à l’intelligence artificielle peut se faire dès le plus jeune âge. En préambule, on prévient son enfant que ces entités virtuelles sont des outils faillibles, que leurs réponses peuvent comporter des erreurs et qu’il doit toujours vérifier ce qui est énoncé. “Ces plateformes peuvent même inventer certaines informations. C’est ce qu’on appelle les hallucinations de l’intelligence artificielle. Il est important de remettre les choses à leur juste place : l’IA est certes un outil qui traite et synthétise la quantité impressionnante d’informations que l’on trouve sur Internet, elle peut en ce sens faire gagner du temps. Mais c’est un outil imparfait auquel on ne peut pas se fier”, précise le conférencier. Par ailleurs, certains jeunes ayant tendance à livrer leurs pensées les plus intimes à leur compagnon numérique, on leur explique que l’IA mémorise toutes les informations, les stocke pour les réutiliser par la suite. Même si c’est tentant et qu’on peut avoir une illusion d’anonymat, il ne faut délivrer aucune donnée personnelle ou sensible lors de discussions.

L’illusion du lien humain

On ne se privera pas de rappeler à son enfant la nature artificielle d’un robot “intelligent”. Il n’est pas un ami, c’est intrinsèquement impossible. Il ne ressent pas d’émotion, ne peut pas faire preuve d’empathie malgré ses propos “bienveillants”. Il ne pense pas, ne comprend pas, ne ressent rien. S’il répond gentiment, c’est le résultat de calculs qui lui permettent de reproduire des styles de conversations existantes et de trouver les mots les plus adaptés pour répondre. Comme le conseille Jacque Henno, on expliquera aussi aux enfants le modèle économique de ces IA génératives. “En allant toujours dans notre sens, elles sont programmées pour qu’on y reste le plus longtemps possible et que l’on devienne dépendant. Avec l’espoir que l’on passe à l’abonnement payant, plus sophistiqué. Ainsi, en passant du temps sur ces plateformes, on fait le jeu de leurs éditeurs.” Plus l’ado est jeune, plus il sera important de lui mettre une limite de temps. “Mon fils de 13 ans passe beaucoup de temps sur ChatGPT. J’ai privilégié le dialogue pour essayer de mettre en place quelques règles d’utilisation afin de le protéger. Pas plus de 20 minutes par jour, pas le soir après le dîner, pas de conversations trop privées ou de secrets confiés…, rapporte Christèle, mère de Quentin. On peut très bien expliquer à son enfant que même si les relations dans la vie réelle sont parfois compliquées, elles lui permettent de grandir et de se construire. Interagir avec les autres, faire face à la contradiction, être à l’écoute, argumenter… C’est d’une grande richesse et c’est ce qui lui apprendra à gérer ses émotions, à développer son esprit critique, à apprécier l’altérité, tout simplement à vivre en société… Aux parents de se montrer disponibles et compréhensifs… Avec un peu de chance, leur enfant n’éprouvera pas le besoin de se confier à une machine.

Les universités lyonnaises au bord de la rupture financière

Les universités lyonnaises au bord de la rupture financière